A inteligência artificial (IA) está revolucionando o mundo e trazendo consigo desafios éticos que requerem atenção. É fundamental desenvolver sistemas de IA de forma responsável, levando em consideração as implicações éticas e sociais. Como lidar com algoritmos que reproduzem vieses discriminatórios? Como garantir o uso ético da IA em todas as suas aplicações? Refletir sobre essas questões e adotar medidas para diminuir os riscos da IA é essencial para um desenvolvimento tecnológico responsável.

No próximo artigo, discutiremos a importância da ética na IA e como ela impacta o desenvolvimento de tecnologias inovadoras. Abordaremos as diretrizes éticas para o desenvolvimento e uso da IA, os desafios éticos enfrentados e as normas e controles necessários para garantir um uso ético da IA. Acompanhe para saber mais sobre como a ética da inteligência artificial pode moldar nosso futuro.

Inteligência Artificial (IA)

A Inteligência Artificial (IA) é uma tecnologia revolucionária que permite que máquinas e sistemas tenham capacidades semelhantes às dos seres humanos. Ela tem a incrível habilidade de raciocinar, reconhecer padrões, tomar decisões e executar uma ampla variedade de tarefas complexas, que anteriormente eram exclusivas da inteligência humana.

A IA está cada vez mais presente em nossa vida cotidiana, desempenhando um papel fundamental em diversos setores e áreas, como saúde, finanças, transporte, entretenimento e muito mais. Ela tem a capacidade de facilitar tarefas complexas, otimizar processos e até mesmo criar novas soluções e inovações, impulsionando o avanço tecnológico e transformando o modo como vivemos e trabalhamos.

Ao desenvolver e utilizar a IA, é imprescindível considerar sua aplicação de forma ética e responsável. Garantir que os sistemas de IA sejam projetados para promover benefícios para a sociedade, respeitar os direitos humanos e evitar consequências negativas é de extrema importância. A busca por um desenvolvimento ético da IA envolve a análise e gestão dos possíveis impactos sociais, econômicos e legais, além de garantir a transparência e a equidade em sua utilização.

A capacidade da IA em reproduzir comportamentos semelhantes aos humanos traz tanto oportunidades quanto desafios. É fundamental estabelecer diretrizes éticas que direcionem o desenvolvimento da IA, promovendo a colaboração entre pessoas e máquinas, a equidade na distribuição dos benefícios gerados pela tecnologia, a privacidade e a segurança dos dados, além de assegurar a responsabilidade e transparência na tomada de decisões.

Ética

A ética é responsável por compreender assuntos relacionados à moral, condutas ideais dos humanos e valores que guiam as ações. É um campo de estudo complexo que busca orientar as ações humanas de forma responsável, respeitando a liberdade, informações e vida do próximo. Na IA, a ética envolve considerar aspectos morais e valores humanos ao projetar, desenvolver e utilizar sistemas de IA, garantindo um uso responsável, justo, transparente e que respeite os direitos e privacidade das pessoas.

Ética no uso da Inteligência Artificial (IA)

A ética no uso da IA é fundamental para garantir um desenvolvimento e aplicação responsáveis de sistemas de IA. Ética refere-se aos princípios e diretrizes que norteiam o comportamento humano, levando em consideração a moral, os valores e o respeito aos direitos das pessoas.

No contexto da IA, é essencial utilizar essa tecnologia de forma ética e responsável, levando em consideração os possíveis impactos e consequências. Isso envolve tomar decisões que estejam alinhadas com aspectos morais e valores humanos, além de respeitar os direitos individuais e a privacidade das pessoas.

Ao utilizar a IA, é importante evitar discriminações e garantir a segurança e transparência em seu uso. Os sistemas de IA devem ser desenvolvidos levando em consideração a diversidade e promovendo a equidade em suas aplicações.

Riscos e responsabilidade

O uso da IA também implica em riscos e responsabilidades. Por exemplo, algoritmos de IA podem reproduzir vieses discriminatórios presentes na sociedade, impactando negativamente certos grupos. É fundamental ter em mente a importância de garantir que a IA seja justa e imparcial em seus resultados.

Além disso, é necessário estabelecer mecanismos de responsabilidade para os sistemas de IA. Quem é responsável por suas ações? Como atribuir responsabilidade em casos de erros ou danos causados por sistemas de IA? Essas questões devem ser consideradas e abordadas de forma ética e responsável.

Privacidade e proteção de dados

A privacidade é outro aspecto crucial no uso da IA. A coleta e processamento de dados pessoais devem ser realizados de forma ética, respeitando o consentimento e os direitos individuais. É fundamental garantir a segurança desses dados e proteger a privacidade das pessoas.

Transparência e confiança

A transparência é um princípio fundamental no uso ético da IA. Os sistemas de IA devem ser claros e compreensíveis para as pessoas, evitando a opacidade e garantindo que suas ações sejam explicáveis. Dessa forma, é possível criar confiança e garantir que a IA seja usada de forma ética e responsável.

Em resumo, a ética no uso da IA é essencial para um desenvolvimento responsável e benéfico dessa tecnologia. Considerar os aspectos morais, respeitar os direitos e a privacidade das pessoas, e garantir transparência e equidade são princípios fundamentais para um uso ético da IA.

Desafios éticos da Inteligência Artificial (IA)

A Inteligência Artificial (IA) apresenta diversos desafios éticos que demandam uma abordagem cuidadosa. Um dos principais desafios é o viés algorítmico, no qual os sistemas de IA podem reproduzir e amplificar os preconceitos existentes na sociedade. Esse viés pode resultar em discriminação e injustiças, prejudicando a equidade e a tomada de decisões imparciais.

Outro desafio ético importante é a privacidade e segurança dos dados. A coleta e processamento de informações pessoais para alimentar os algoritmos de IA podem levar a violações de privacidade, colocando em risco a confidencialidade e a proteção dos indivíduos.

Além disso, a atribuição de responsabilidade por ações tomadas por sistemas de IA é outro desafio ético. Como responsabilizar um algoritmo por decisões que impactam vidas humanas? Quem deve ser responsabilizado em casos de erro ou dano causado por um sistema de IA?

Por fim, o impacto da IA no mercado de trabalho é um desafio ético e social. O avanço da automação e da inteligência artificial pode resultar na substituição de empregos por máquinas, o que levanta questões sobre a responsabilidade de fornecer oportunidades de trabalho e garantir a dignidade das pessoas afetadas por essas mudanças.

Desafios Éticos da Inteligência Artificial (IA)

| Desafio Ético | Descrição |

|---|---|

| Viés algorítmico | Reprodução e ampliação de preconceitos |

| Privacidade e segurança | Coleta e processamento de dados pessoais |

| Atribuição de responsabilidade | Quem é responsável por ações dos sistemas de IA? |

| Impacto no mercado de trabalho | Substituição de empregos por máquinas |

Esses desafios éticos exigem soluções cuidadosas e uma abordagem responsável no desenvolvimento e aplicação da IA. É essencial estabelecer diretrizes claras e mecanismos de governança para lidar com essas questões, garantindo que a IA seja utilizada para beneficiar a sociedade como um todo, respeitando os direitos individuais, a privacidade e a equidade.

A responsabilidade de enfrentar esses desafios éticos não é apenas das organizações e dos desenvolvedores de IA, mas também da sociedade como um todo. É necessário um diálogo aberto e contínuo para encontrar soluções éticas e garantir que a IA seja uma ferramenta poderosa para o avanço da sociedade, com responsabilidade e respeito aos valores humanos.

Para entender melhor os desafios éticos da IA, é necessário um enfoque multidisciplinar e a colaboração entre especialistas em ética, direito, ciência da computação e sociedade. A busca por soluções éticas nos desafios da IA é um caminho essencial para um desenvolvimento tecnológico responsável, garantindo benefícios para todos e evitando possíveis consequências negativas.

Diretrizes éticas para o desenvolvimento da Inteligência Artificial (IA)

Para garantir um desenvolvimento ético da Inteligência Artificial (IA), é essencial seguir diretrizes que promovam a avaliação constante, colaboração, equidade, privacidade, responsabilidade, segurança e transparência. Essas diretrizes atuam como guias para orientar o desenvolvimento e implementação responsável da IA, buscando produzir resultados imparciais, justos, diversificados e legais, que impulsionem os benefícios da IA na sociedade.

- Avaliações constantes: É fundamental realizar avaliações periódicas de sistemas de IA, identificando e corrigindo possíveis vieses, erros ou efeitos indesejados. Essa prática garante que a IA esteja alinhada com as normas éticas e possa aprender e evoluir de maneira responsável.

- Colaboração entre inteligência humana e IA: A colaboração entre humanos e IA é essencial para garantir que os sistemas atendam às necessidades e valores éticos da sociedade. Ao envolver especialistas humanos nos processos de desenvolvimento e tomada de decisões, é possível evitar a reprodução de preconceitos e garantir que a IA seja utilizada de forma justa e responsável.

- Equidade e justiça: As diretrizes éticas devem assegurar que a IA seja desenvolvida e aplicada com equidade, evitando discriminações indevidas. É importante considerar a ampla diversidade da sociedade e garantir que a IA beneficie a todos, sem perpetuar desigualdades ou preconceitos.

- Proteção da privacidade: A privacidade dos dados pessoais deve ser protegida durante o desenvolvimento e uso da IA. É necessário garantir que os sistemas respeitem as leis de privacidade, obtenham o consentimento adequado dos usuários e adotem medidas de segurança adequadas para evitar violações.

- Mecanismos de responsabilidade: As diretrizes éticas devem estabelecer mecanismos claros de responsabilidade para os sistemas de IA. É importante definir quem é responsável pelas ações e decisões tomadas pelos sistemas, garantindo que as consequências indesejadas sejam atribuídas e solucionadas de forma adequada.

- Garantia de segurança: A segurança dos sistemas de IA é fundamental para evitar danos e incidentes indesejados. É necessário garantir que os sistemas sejam protegidos contra ataques cibernéticos, utilizem práticas de segurança adequadas e sigam padrões reconhecidos de segurança da informação.

- Promoção da transparência: A transparência é essencial para promover a confiança e compreensão dos sistemas de IA. As diretrizes devem exigir a divulgação clara de como os sistemas funcionam, quais dados são utilizados, quais decisões são tomadas e como são tratados possíveis vieses e efeitos indesejados.

Seguir essas diretrizes é fundamental para o desenvolvimento ético da IA, assegurando que os sistemas sejam utilizados de forma responsável, benéfica e justa para a sociedade. Ao adotar esses princípios, é possível explorar todo o potencial da IA, promovendo inovação e avanço de forma ética e sustentável.

| Diretrizes Éticas | Descrição |

|---|---|

| Avaliações constantes | Realizar avaliações periódicas de sistemas de IA, identificando e corrigindo possíveis vieses, erros ou efeitos indesejados. |

| Colaboração entre inteligência humana e IA | Promover a colaboração entre humanos e IA, envolvendo especialistas humanos nos processos de desenvolvimento e tomada de decisões. |

| Equidade e justiça | Desenvolver e aplicar a IA com equidade, evitando discriminações e beneficiando a todos, sem perpetuar desigualdades. |

| Proteção da privacidade | Proteger a privacidade dos dados pessoais durante o desenvolvimento e uso da IA, seguindo as leis e adotando medidas de segurança adequadas. |

| Mecanismos de responsabilidade | Estabelecer mecanismos claros de responsabilidade para os sistemas de IA, atribuindo consequências e solucionando problemas de forma adequada. |

| Garantia de segurança | Assegurar a segurança dos sistemas de IA, protegendo contra ataques cibernéticos e seguindo padrões de segurança reconhecidos. |

| Promoção da transparência | Promover a transparência dos sistemas de IA, divulgando claramente seu funcionamento, dados utilizados, decisões tomadas e tratamento de vieses e efeitos indesejados. |

Normas e controles para o uso ético da Inteligência Artificial (IA)

Para garantir o uso ético da IA, foi criada a Estratégia Brasileira de Inteligência Artificial (EBIA) e estão sendo desenvolvidas normas e controles relacionados ao uso responsável da IA no Brasil. A EBIA visa elaborar princípios éticos e diretrizes para o desenvolvimento e uso da IA. Além disso, existe um projeto de lei (PL 2338/2023) que propõe regulamentar o desenvolvimento e uso da IA, estabelecendo princípios, direitos, deveres e instrumentos de governança. A criação de normas e controles é fundamental para garantir que a IA seja utilizada de forma ética e responsável.

A EBIA, juntamente com o projeto de lei, busca estabelecer uma base sólida para o uso ético da IA no Brasil. Essas iniciativas visam tornar a IA uma ferramenta que beneficie a sociedade como um todo, promovendo a transparência, privacidade, responsabilidade e segurança em seu uso. Ao estabelecer normas e controles, é possível orientar a pesquisa, desenvolvimento e implementação da IA de acordo com princípios éticos definidos, buscando evitar e mitigar os possíveis riscos e impactos negativos.

As normas e controles para o uso ético da IA estão em constante evolução, à medida que novas descobertas e desafios surgem nessa área. É fundamental que instituições governamentais, órgãos reguladores, pesquisadores, empresas e sociedade civil estejam envolvidos nesse processo, contribuindo com seus conhecimentos e perspectivas para garantir um desenvolvimento responsável da IA.

Princípios éticos propostos pela EBIA

A Estratégia Brasileira de Inteligência Artificial propõe um conjunto de princípios éticos que devem nortear o desenvolvimento e uso da IA:

- Transparência: Garantir que os sistemas de IA sejam transparentes em suas ações e funcionamentos, permitindo uma compreensão clara de como tomam decisões e influenciam o mundo ao seu redor.

- Equidade: Assegurar que os benefícios da IA sejam distribuídos de forma justa e igualitária, evitando a reprodução de desigualdades e discriminações existentes.

- Privacidade: Proteger os dados pessoais das pessoas, garantindo o respeito à privacidade e a adoção de medidas para evitar o uso indevido ou abusivo das informações.

- Responsabilidade: Estabelecer mecanismos que atribuam responsabilidade às ações da IA, permitindo ações corretivas em caso de danos ou prejuízos causados por sistemas de IA.

- Segurança: Assegurar que os sistemas de IA sejam seguros, minimizando os riscos de falhas, ataques cibernéticos e utilização indevida.

- Colaboração: Promover a colaboração entre diferentes atores, como governos, empresas, academia e sociedade civil, para o desenvolvimento e uso responsável da IA.

Esses princípios éticos servem como guia para o desenvolvimento de normas e controles que regulem o uso da IA, garantindo que seus benefícios sejam maximizados e seus riscos minimizados. Ao seguir tais princípios, é possível construir um ecossistema de IA ético, confiável e responsável, que contribua para o avanço da sociedade, respeitando os valores e direitos fundamentais.

| Normas e Controles para o Uso Ético da IA | Status | Descrição |

|---|---|---|

| Estratégia Brasileira de Inteligência Artificial (EBIA) | Em andamento | Elaboração de princípios éticos e diretrizes para o desenvolvimento e uso da IA no Brasil. |

| Projeto de Lei 2338/2023 | Em tramitação | Proposta de regulamentação do desenvolvimento e uso da IA, estabelecendo princípios, direitos, deveres e instrumentos de governança. |

A criação de normas e controles para o uso ético da IA é uma prioridade global. O Brasil está se posicionando de forma estratégica nesse cenário, com a EBIA e o projeto de lei como importantes iniciativas nacionais. A partir dessas ações, espera-se estabelecer um ambiente ético, seguro e responsável para o desenvolvimento e uso da IA, beneficiando a sociedade como um todo.

O papel da ética no desenvolvimento e aplicação da Inteligência Artificial (IA)

A ética desempenha um papel fundamental no desenvolvimento e aplicação da IA. É importante garantir que a IA seja utilizada para o bem e para o avanço da sociedade, evitando consequências negativas. Com o desenvolvimento ético da IA, é possível obter benefícios como automação de tarefas complexas, previsão de comportamentos e auxílio em tomadas de decisões. No entanto, é preciso estar atento aos riscos, como vieses algorítmicos discriminatórios e violações de privacidade. A sociedade deve estar engajada nos desafios e oportunidades trazidos pela IA para garantir um uso ético e benéfico.

Para compreender o papel da ética no desenvolvimento e aplicação da IA, é necessário reconhecer a importância de abordar as implicações éticas desde os estágios iniciais. O avanço da IA traz consigo uma série de benefícios, como a automação de tarefas repetitivas e complexas, a previsão de comportamentos e a capacidade de auxiliar em tomadas de decisões. No entanto, é fundamental que esses avanços sejam realizados de forma ética, para evitar consequências negativas e garantir o bem-estar da sociedade como um todo.

Ao desenvolver e aplicar a IA, é crucial estar ciente dos riscos envolvidos, como os vieses algorítmicos discriminatórios e as violações de privacidade. A ética desempenha um papel fundamental na mitigação desses riscos, proporcionando orientação e diretrizes para um desenvolvimento responsável. Ela permite avaliar as implicações sociais e éticas de cada aplicação da IA, garantindo que sejam respeitados os princípios de justiça, equidade, privacidade, responsabilidade e transparência.

Um desenvolvimento ético da IA possibilita a criação de sistemas que beneficiam a sociedade como um todo. Esses sistemas podem automatizar tarefas complexas, reduzir erros humanos e fornecer insights valiosos para a tomada de decisões. Além disso, a IA pode contribuir para o avanço científico, a descoberta de novas soluções para problemas complexos e até mesmo para melhorar a qualidade de vida das pessoas.

No entanto, os benefícios da IA só serão maximizados se forem acompanhados de uma abordagem ética. O desenvolvimento e a aplicação não ética da IA podem levar a consequências indesejáveis, como discriminação algorítmica e a violação da privacidade das pessoas. É importante que a sociedade, os desenvolvedores e os reguladores estejam engajados nos desafios e oportunidades trazidos pela IA, para garantir um desenvolvimento responsável e ético.

A ética no desenvolvimento e aplicação da IA é uma questão multifacetada que requer a participação de diversos atores, como cientistas, desenvolvedores, legisladores e a sociedade em geral. É preciso estabelecer diretrizes claras e mecanismos de responsabilidade para garantir o uso ético da IA em todas as suas aplicações. Dessa forma, podemos aproveitar os benefícios da IA e mitigar os riscos, garantindo um futuro tecnológico responsável e benéfico para todos.

Direitos humanos e a importância da ética na Inteligência Artificial (IA)

Os direitos humanos desempenham um papel importante na ética da IA. É essencial garantir que a IA respeite os direitos fundamentais das pessoas, como a igualdade, não discriminação e privacidade. A IA tem um impacto direto na vida e na sociedade, e por isso é necessário refletir sobre seus impactos e consequências éticas. A ética na IA busca assegurar que seus resultados e comportamentos estejam alinhados aos direitos humanos e promovam o bem-estar de todos.

A IA, por sua natureza de automatizar tarefas e tomar decisões, pode influenciar diretamente a vida das pessoas. É importante que essas influências sejam positivas e respeitem os direitos universais estabelecidos pelos direitos humanos. A igualdade é um princípio fundamental da ética na IA, que busca garantir que a tecnologia não discrimine ou exclua grupos específicos da sociedade com base em características como raça, gênero, religião ou origem étnica.

A privacidade também é um aspecto importante da ética na IA. A coleta e o processamento de dados pessoais devem ser realizados de forma transparente e responsável, garantindo o consentimento e a proteção das informações das pessoas envolvidas. Além disso, é necessário garantir a segurança dos dados e evitar violações que possam comprometer a privacidade das pessoas.

A ética na IA também busca promover a responsabilidade pelos impactos das decisões tomadas pelos sistemas de IA. É preciso estabelecer mecanismos de prestação de contas e explicabilidade, para que as pessoas afetadas pelas decisões da IA possam compreender os processos e as lógicas envolvidas. Isso permite que sejam identificadas e corrigidas quaisquer injustiças ou erros que possam ocorrer.

As considerações éticas na IA visam garantir que a tecnologia seja utilizada de forma a promover o bem-estar e o benefício mútuo da sociedade. Ao garantir que os direitos humanos sejam respeitados, a ética na IA trabalha para evitar e corrigir possíveis danos, promover a igualdade de oportunidades e maximizar os benefícios para todos os indivíduos e grupos sociais envolvidos.

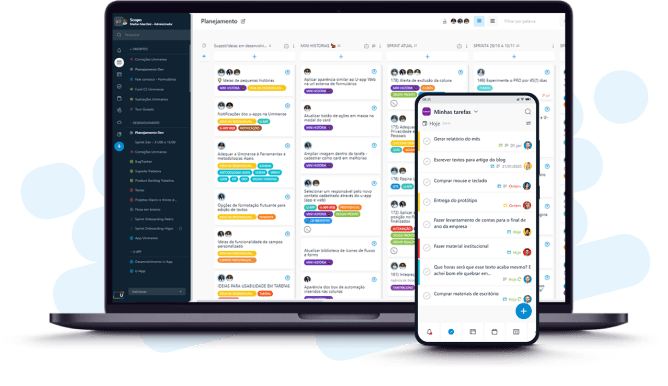

A imagem acima ilustra a importância dos direitos humanos e da ética na IA. Ela simboliza a necessidade de equilíbrio entre a tecnologia e os valores humanos, destacando a responsabilidade de garantir que a IA seja orientada para o benefício da sociedade como um todo.

Como aplicar a ética no desenvolvimento e uso da Inteligência Artificial (IA)

A aplicação da ética no desenvolvimento e uso da IA é um aspecto crucial para garantir que essa tecnologia seja benéfica e responsável para todos. Para isso, é necessário seguir as diretrizes éticas mencionadas anteriormente e integrá-las em todas as etapas do processo.

Avaliações periódicas são fundamentais para acompanhar o desenvolvimento da IA e identificar possíveis riscos éticos. Essas avaliações devem considerar aspectos como a imparcialidade dos algoritmos, a privacidade dos dados e possíveis impactos sociais e econômicos.

A colaboração entre a inteligência humana e a IA também desempenha um papel importante na aplicação da ética. A interação entre especialistas em ética, desenvolvedores de IA e usuários finais ajuda a garantir que a IA seja orientada por valores humanos e esteja alinhada com as necessidades e expectativas da sociedade.

A equidade é outro elemento essencial na aplicação da ética na IA. É importante garantir que a IA seja desenvolvida e utilizada de forma justa, considerando e minimizando possíveis viéses discriminatórios. A equidade envolve uma distribuição igualitária dos benefícios da IA e a eliminação de qualquer forma de discriminação.

A proteção da privacidade dos indivíduos também é um aspecto ético crucial no desenvolvimento e uso da IA. Os sistemas de IA devem ser projetados levando em consideração a segurança dos dados e respeitando a privacidade das pessoas. Mecanismos de transparência e consentimento informado devem ser adotados para garantir que os indivíduos tenham controle sobre seus dados pessoais.

A responsabilidade é um princípio ético fundamental na aplicação da IA. Os desenvolvedores e usuários da IA devem ser responsáveis pelas decisões tomadas pelos sistemas de IA e pelos impactos que eles causam. Isso implica em tomar medidas para corrigir falhas, garantir a segurança dos sistemas e assumir a responsabilidade por quaisquer consequências negativas.

A segurança é um elemento essencial na aplicação da ética na IA. Os sistemas de IA devem ser projetados e implementados levando em consideração possíveis vulnerabilidades e riscos de segurança. Mecanismos de segurança robustos devem ser incorporados para garantir a integridade e confiabilidade dos sistemas.

A transparência é um valor ético fundamental na IA. Os sistemas de IA devem ser transparentes em relação ao seu funcionamento, lógica de tomada de decisões e impactos. Isso inclui a adoção de medidas para explicabilidade dos resultados obtidos pela IA, permitindo que os usuários compreendam e questionem as decisões tomadas pelos sistemas.

| Elementos Essenciais da Aplicação da Ética na IA |

|---|

| Avaliações periódicas |

| Colaboração entre inteligência humana e IA |

| Equidade |

| Proteção da privacidade |

| Responsabilidade |

| Segurança |

| Transparência |

Considerar a ética desde os estágios iniciais do desenvolvimento da IA é fundamental para garantir um uso ético e responsável dessa tecnologia. Ao aplicar a ética no desenvolvimento e uso da IA, é possível maximizar os benefícios e minimizar os riscos, criando um ambiente de confiança e promovendo o bem-estar de todos.

Conclusão

A ética na Inteligência Artificial (IA) é essencial para um desenvolvimento responsável da tecnologia. Garantir o uso ético da IA, considerando direitos humanos, privacidade, responsabilidade e transparência, é fundamental para maximizar os benefícios e minimizar os riscos associados ao seu uso.

Refletir sobre os desafios éticos da IA e aplicar diretrizes éticas no seu desenvolvimento e uso contribuem para uma sociedade inclusiva e ética. É através da ética que é possível estabelecer uma base sólida para uma inteligência artificial responsável e benéfica para todos.

Portanto, é necessário estar atento aos princípios éticos ao projetar, desenvolver e aplicar a IA, assegurando que os sistemas sejam desenvolvidos de maneira justa, transparente e responsável. Assim, poderemos colher os frutos da IA, impulsionando a inovação, melhorando a eficiência e promovendo o bem-estar da sociedade, sempre respeitando os valores e direitos fundamentais dos indivíduos.

FAQ

O que é ética da inteligência artificial?

É a área de estudo que busca orientar o desenvolvimento e uso da inteligência artificial (IA) de forma responsável, levando em consideração aspectos morais, valores humanos, direitos das pessoas e privacidade.

Qual é o papel da ética na IA?

A ética na IA é fundamental para garantir um desenvolvimento tecnológico responsável, evitando consequências negativas e garantindo benefícios para a sociedade. Ela busca assegurar que a IA seja utilizada de forma ética, responsável, justa e transparente.

Quais são os desafios éticos da IA?

Alguns desafios éticos da IA incluem o viés algorítmico, a privacidade e segurança dos dados, a atribuição de responsabilidade por ações da IA e o impacto no mercado de trabalho.

Como aplicar a ética no uso da IA?

A aplicação da ética no uso da IA envolve seguir diretrizes éticas, como realizar avaliações e ajustes constantes, promover a colaboração entre inteligência humana e IA, garantir a equidade e justiça, proteger a privacidade, estabelecer mecanismos de responsabilidade, garantir a segurança e promover a transparência.

Existe regulamentação para o uso ético da IA?

Sim, no Brasil foi criada a Estratégia Brasileira de Inteligência Artificial (EBIA) e está em desenvolvimento um projeto de lei (PL 2338/2023) que propõe regulamentar o desenvolvimento e uso da IA, estabelecendo princípios, direitos, deveres e instrumentos de governança.

Qual é o papel dos direitos humanos na ética da IA?

Os direitos humanos são fundamentais na ética da IA, pois é necessário garantir que a IA respeite direitos fundamentais, como a igualdade, não discriminação e privacidade.

Por que é importante aplicar a ética na IA?

A aplicação da ética na IA é importante para garantir que a tecnologia seja utilizada para o bem da sociedade, evitando consequências negativas. Também é fundamental para maximizar os benefícios e minimizar os riscos associados ao seu uso.